Es passiert gerade ständig: Ein Team beendet einen Strategieworkshop, nutzt Claude oder ChatGPT, um ihre Gedanken von den Post-it Notes an der Wand in ein Strategiepapier zu packen. Alle überfliegen das Papier und nicken. Sieht gut aus. Doch kaum ausgesandt, trudelt das Feedback ein. Die Einen loben es. Andere finden es merkwürdig generisch, erkennen KI-Floskeln und hören auf zu lesen. Gleiches Dokument. Ganz unterschiedliche Reaktionen.

Warum?

Weil Bedeutung nicht im Text steckt. Sie entsteht erst im Akt des Lesens.

➡️ Das hat Medientheoretiker Stuart Hall bereits in den 1970ern beschrieben.

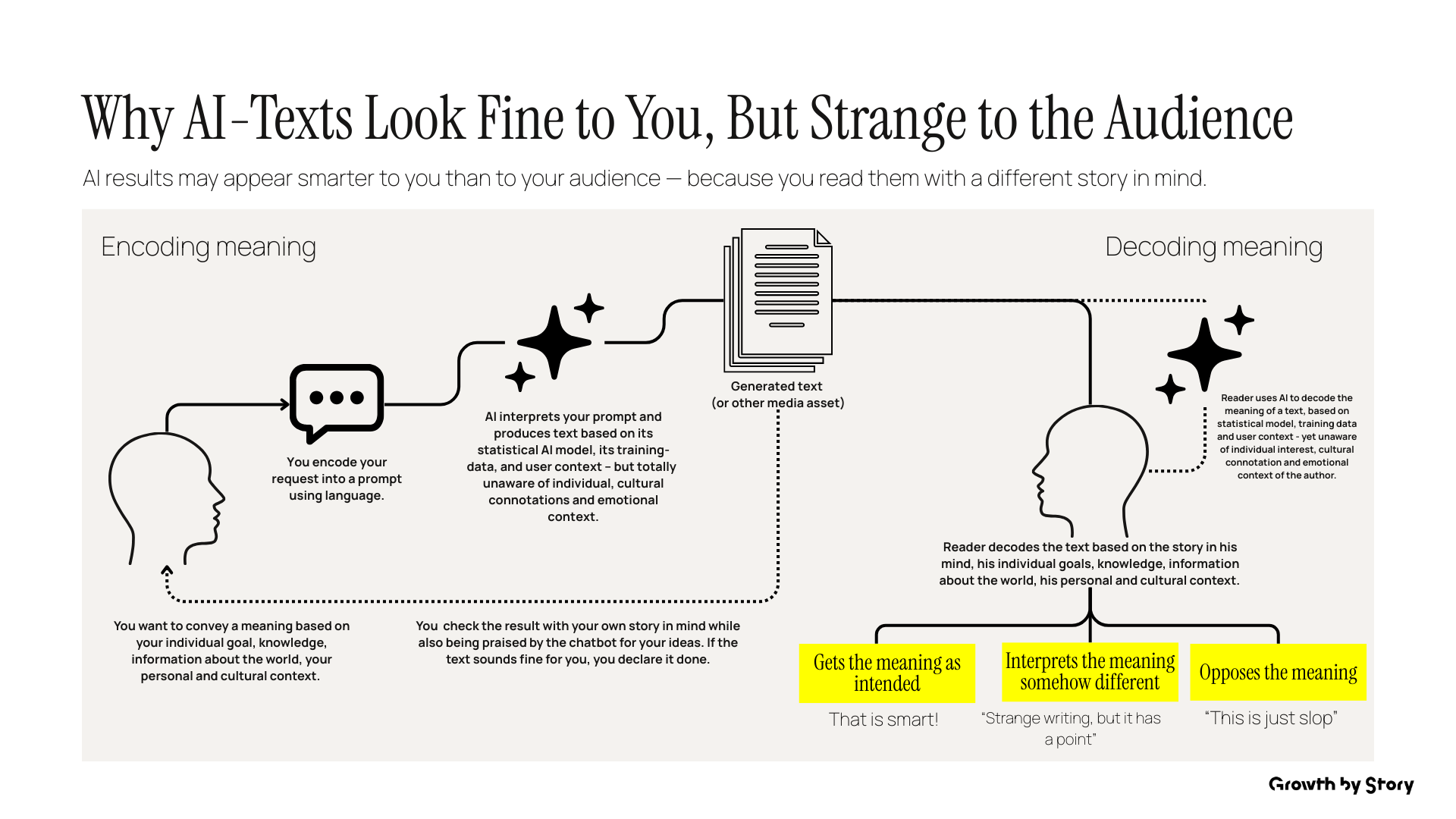

Seine Encoding/Decoding-Theorie sagt: Kommunikation ist kein einfacher Transfer von Bedeutung. Sender:innen encodieren *Bedeutung über Sprache, kulturelle Referenzen und Kontext. Leser:*innen decodieren sie durch den eigenen Kontext. Und weil sich ihre Kontexte nie vollständig decken, werden Botschaften umgedeutet oder zurückgewiesen.

Bedeutung über jedwede Sprache zu teilen war schon immer schwierig.

➡️ KI fügt eine weitere Ebene des Encodings hinzu – und die ist blind für Bedeutung und Kultur.

Wenn du eine KI promptest, encodierst du deine Absicht, eine Bedeutung mitzuteilen, in Worte. Die KI re-encodiert diese Absicht zu einem Text, basierend auf statistischen Mustern aus den Trainingsdaten, und eben nicht auf Basis deines kulturellen Kontexts, deiner emotionalen Situation oder dem unausgesprochenen Dingen, die zwischen den Zeilen gesagt werden.

Wenn Du aber das Ergebnis der AI liest, bewertest du es aber mit all dem im Hinterkopf. Und schlimmer noch: Die KI bestätigt dir sogar, dass dein Prompt und deine Ideen großartig sind. Und so entsteht schnell der Gedanke: Klingt doch für mich gut, also muss es auch fürs Publikum gut klingen. Genau da liegt das Problem.

Dein Publikum decodiert Bedeutung wahrscheinlich mit völlig anderen Geschichten im Kopf. Was dort ankommt, liest sich vielleicht auf den ersten Blick kohärent. Trotzdem kann es sich kulturell hohl anfühlen. Die Konnotationen stimmen nicht. Der Subtext fehlt. Oder schlimmer: Der Text sagt etwas Unbeabsichtigtes.

KI hat Textproduktion extrem vereinfacht. Gleichzeitig haben wir dem ohnehin komplexen Prozess menschlicher Kommunikation eine neue, kontextfreie Zwischenstufe hinzugefügt.

➡️ Und jetzt? Drei Gedanken:

✳️ Stand heute ist KI besonders gut bei Texten, die größtenteils wörtlich gelesen werden sollen: Code, To-do-Listen, Rezepte, Service-Antworten und Zusammenfassungen. Je mehr es um die reine Denotation geht, desto besser funktioniert KI.

✳️ Wichtige Dokumente, bei denen es auf Nuancen ankommt, müssen weiterhin von Menschen gegengelkesen werden, nicht von einem anderen KI-Modell.

✳️ Besondere Vorsicht sollte bei Texten gelten, die auch Bedeutung „zwischen den Zeilen“ übertragen müssen: eine Brand Voice, ein kulturelles Augenzwinkern, ein emotionales Argument, eine politische Haltung.

Letztlich braucht es weiterhin viel menschliche Redaktion, um „Bedeutung“ in Medien zu encodieren. Und selbst wenn das die bestbezahlten Leute machen, ist Bedeutung nie zu 100% fix. Ein schönes Beispiel: Comic-Fans schauen einen Multimillionen-Dollar-Marvel-Film. Jedes noch so kleines Detail ist eine bewusste kreative Entscheidung ist, um die Bedeutung der Story zu vermitteln. Trotzdem werden einige begeistert sein, während andere sich darüber aufregen, wie schlecht er ist.